صفقة OpenAI مع البنتاغون: سام ألتمان يؤمن عقد ذكاء اصطناعي حاسم مع ضمانات تقنية

BitcoinWorld

صفقة OpenAI مع البنتاغون: سام ألتمان يؤمن عقد وكيل الذكاء الاصطناعي حاسم مع ضمانات تقنية

في تطور بارز لحوكمة الذكاء الاصطناعي، أعلن الرئيس التنفيذي لشركة OpenAI سام ألتمان عن عقد دفاعي مهم مع وزارة الدفاع يوم الجمعة، 13 أكتوبر 2025، مع إنشاء ضمانات تقنية تعالج المخاوف الأخلاقية الحرجة المحيطة بتطبيقات الذكاء الاصطناعي العسكرية. يأتي هذا الاتفاق بعد مواجهة مثيرة للجدل بين البنتاغون وشركة Anthropic المنافسة في مجال الذكاء الاصطناعي، مما يسلط الضوء على التقاطع المعقد بين الأمن القومي والابتكار التكنولوجي والقيم الديمقراطية في عالم يتزايد فيه التشغيل الآلي.

صفقة OpenAI مع البنتاغون مع الضمانات التقنية

كشف سام ألتمان أن OpenAI توصلت إلى اتفاق يسمح لوزارة الدفاع بالوصول إلى نماذج الذكاء الاصطناعي الخاصة بها ضمن الشبكات السرية. والأهم من ذلك، يتضمن العقد حماية تقنية محددة تعالج مصدرين أخلاقيين أساسيين. أولاً، يحظر الاتفاق تطبيقات المراقبة الجماعية المحلية. ثانياً، يحافظ على المسؤولية البشرية عن استخدام القوة، بما في ذلك أنظمة الأسلحة الذاتية. تمثل هذه الضمانات موقفاً وسطاً بين الوصول العسكري غير المقيد والرفض المؤسسي الكامل.

وفقاً لبيان ألتمان العام، توافق وزارة الدفاع على هذه المبادئ وأدرجتها في كل من القانون والسياسة. علاوة على ذلك، ستنفذ OpenAI ضمانات تقنية لضمان توافق سلوك النموذج مع هذه القيود. ستنشر الشركة أيضاً مهندسين للعمل جنباً إلى جنب مع موظفي البنتاغون، مما يسهل التنفيذ السليم للنموذج ومراقبة المخاطر في الوقت الفعلي المستمرة. يميز هذا النهج التعاوني استراتيجية OpenAI عن المواقف الصناعية الأكثر عدائية.

مواجهة Anthropic والانقسامات الأخلاقية

يظهر اتفاق OpenAI على خلفية المفاوضات الفاشلة بين البنتاغون وAnthropic. لعدة أشهر، دفع مسؤولو الدفاع شركات الذكاء الاصطناعي للسماح باستخدام نماذجها "لجميع الأغراض القانونية". ومع ذلك، سعت Anthropic إلى قيود صريحة على المراقبة الجماعية المحلية والأسلحة الذاتية بالكامل. جادل الرئيس التنفيذي داريو أمودي بأنه في حالات محددة، يمكن أن يقوض الذكاء الاصطناعي القيم الديمقراطية بدلاً من الدفاع عنها.

جذب هذا الموقف الأخلاقي دعماً كبيراً من عمال التكنولوجيا. وقع أكثر من 60 موظفاً في OpenAI و300 موظف في Google رسالة مفتوحة تؤيد موقف Anthropic. دعت الرسالة إلى اعتماد حدود أخلاقية مماثلة على مستوى الصناعة، مما يعكس القلق المتزايد بين مطوري الذكاء الاصطناعي بشأن التطبيقات العسكرية المحتملة لتقنياتهم.

تصاعد الخلاف إلى مواجهة علنية مع إدارة ترامب. انتقد الرئيس دونالد ترامب Anthropic باعتبارها "مجانين يساريين" في منشور على وسائل التواصل الاجتماعي. وجه الوكالات الفيدرالية للتخلص التدريجي من منتجات الشركة خلال ستة أشهر. كما كثف وزير الدفاع بيت هيغسيث الصراع بتصنيف Anthropic كخطر على سلسلة التوريد. يحظر هذا التصنيف على المقاولين والشركاء الذين يتعاملون مع الجيش من الانخراط تجارياً مع Anthropic.

آثار الصناعة والمشهد التنظيمي

تكشف النتائج المتناقضة لـ OpenAI وAnthropic عن آثار كبيرة لصناعة الذكاء الاصطناعي. يجب على الشركات الآن التنقل في علاقات معقدة مع الكيانات الحكومية مع الحفاظ على المعايير الأخلاقية والثقة العامة. يوضح نهج OpenAI أن الاتفاقات التفاوضية مع ضمانات محددة تمثل مساراً قابلاً للتطبيق للمضي قدماً. على العكس من ذلك، تظهر تجربة Anthropic العواقب المحتملة لاتخاذ موقف أخلاقي أكثر حزماً ضد مطالب الحكومة.

يحدث هذا الوضع في سياق تنظيمي أوسع. تقوم عدة دول بتطوير أطر لتطبيقات الذكاء الاصطناعي العسكرية. أجرت الأمم المتحدة مناقشات مستمرة حول أنظمة الأسلحة الذاتية الفتاكة. بالإضافة إلى ذلك، نفذ الاتحاد الأوروبي مؤخراً قانون الذكاء الاصطناعي الخاص به، والذي يتضمن أحكاماً محددة للتطبيقات عالية المخاطر. تخلق هذه التطورات العالمية بيئة معقدة بشكل متزايد لشركات الذكاء الاصطناعي العاملة في قطاعات الدفاع.

التنفيذ الفني وبروتوكولات السلامة

يتضمن اتفاق OpenAI عدة مكونات تقنية مصممة لضمان الامتثال للضمانات الأخلاقية. وفقاً لمراسلة فورتشن شارون جولدمان، أبلغ ألتمان الموظفين أن الحكومة ستسمح لـ OpenAI ببناء "مجموعة السلامة" الخاصة بها لمنع سوء الاستخدام. تمثل هذه البنية التحتية التقنية مكوناً حاسماً للاتفاقية. علاوة على ذلك، إذا رفض نموذج OpenAI أداء مهمة محددة، فلا يمكن للحكومة إجبار الشركة على تعديل سلوك النموذج.

تعالج هذه التدابير التقنية المخاوف الأساسية بشأن موثوقية نظام الذكاء الاصطناعي ومواءمته. إنها توفر آليات لضمان بقاء سلوك الذكاء الاصطناعي ضمن الحدود الأخلاقية المعمول بها. يسهل نشر مهندسي OpenAI للعمل مباشرة مع موظفي البنتاغون التنفيذ السليم والمراقبة المستمرة. يمثل هذا الإشراف الفني التعاوني نهجاً مبتكراً للشراكات العسكرية والشركات في مجالات التكنولوجيا الحساسة.

مقارنة نهج شركات الذكاء الاصطناعي للعقود العسكرية| الشركة | الموقف | الضمانات الرئيسية | استجابة الحكومة |

|---|---|---|---|

| OpenAI | اتفاق تفاوضي | • لا مراقبة جماعية محلية • مسؤولية بشرية عن القوة • ضمانات تقنية • نشر المهندسين | عقد ممنوح مع ضمانات |

| Anthropic | قيود أخلاقية | • لا مراقبة جماعية • لا أسلحة ذاتية • حماية القيم الديمقراطية | تصنيف مخاطر سلسلة التوريد أمر بالتخلص التدريجي من المنتج |

السياق الأوسع والتطورات الدولية

يتزامن اتفاق OpenAI-البنتاغون مع تطورات دولية كبيرة. بعد فترة وجيزة من إعلان ألتمان، ظهرت أخبار حول إجراءات عسكرية أمريكية وإسرائيلية ضد إيران. دعا الرئيس ترامب إلى الإطاحة بالحكومة الإيرانية. تسلط هذه التطورات المتزامنة الضوء على المشهد الجيوسياسي المعقد الذي يتم فيه نشر تقنيات الذكاء الاصطناعي العسكرية. كما أنها تؤكد على أهمية الاعتبارات الأخلاقية المحيطة بالأنظمة الذاتية وقدرات المراقبة.

على الصعيد العالمي، تتبع الدول أساليب متنوعة لدمج الذكاء الاصطناعي العسكري:

- الصين تتابع بقوة تطبيقات الذكاء الاصطناعي العسكرية مع قيود أخلاقية عامة أقل

- روسيا نشرت أنظمة ذاتية في مناطق الصراع بشفافية محدودة

- الدول الأوروبية اعتمدت عموماً مناهج أكثر حذراً مع رقابة أقوى

- الأمم المتحدة تستمر المناقشات بشأن المعاهدات المحتملة على الأسلحة الذاتية

يخلق هذا السياق الدولي ضغوطاً تنافسية تؤثر على قرارات السياسة المحلية. تواجه الولايات المتحدة تحدي الحفاظ على التفوق التكنولوجي مع دعم القيم الديمقراطية والمعايير الأخلاقية. يمثل اتفاق OpenAI نهجاً واحداً لتحقيق التوازن بين هذه الأولويات المتنافسة.

وجهات نظر الموظفين وأخلاقيات الصناعة

تكشف الرسالة المفتوحة الموقعة من مئات موظفي الذكاء الاصطناعي عن توترات صناعية داخلية كبيرة. يتساءل عمال التكنولوجيا بشكل متزايد عن الآثار الأخلاقية لعملهم، خاصة فيما يتعلق بالتطبيقات العسكرية. يمثل هذا النشاط للموظفين ظاهرة جديدة نسبياً في قطاع تكنولوجيا الدفاع. تاريخياً، واجه مقاولو الدفاع مقاومة داخلية أقل للتطبيقات العسكرية. ومع ذلك، تجذب شركات الذكاء الاصطناعي موظفين لديهم قناعات أخلاقية قوية حول تأثير التكنولوجيا على المجتمع.

تخلق هذه الديناميكية تحديات إدارية لشركات الذكاء الاصطناعي التي تسعى للحصول على عقود دفاعية. يجب على القيادة الموازنة بين العلاقات الحكومية والفرص التجارية ومخاوف الموظفين. يمثل نهج OpenAI للتفاوض على ضمانات محددة استراتيجية واحدة لمعالجة هذه الضغوط المتنافسة. تشير رغبة الشركة في الدعوة علناً لاعتماد شروط مماثلة على مستوى الصناعة إلى محاولة لإنشاء معايير أخلاقية مع الحفاظ على الوصول الحكومي.

الآثار القانونية والسياسية

يثير تصنيف مخاطر سلسلة التوريد Anthropic أسئلة قانونية كبيرة. صرحت الشركة أنها ستطعن في أي تصنيف من هذا القبيل في المحكمة. يمكن أن تؤسس هذه القضية المحتملة سوابق مهمة فيما يتعلق بسلطة الحكومة لتقييد العلاقات التجارية بناءً على المواقف الأخلاقية للشركات. قد تؤثر النتيجة على كيفية تعامل شركات الذكاء الاصطناعي الأخرى مع مفاوضات مماثلة مع الكيانات الحكومية.

يلاحظ خبراء السياسة عدة اعتبارات رئيسية:

- التوازن بين احتياجات الأمن القومي والاستقلالية الأخلاقية للشركات

- الدور المناسب للضمانات التقنية في أنظمة الذكاء الاصطناعي العسكرية

- آليات ضمان الامتثال للقيود الأخلاقية

- الآثار الدولية للنهج الوطنية المختلفة

من المرجح أن تتلقى هذه الأسئلة السياسية اهتماماً متزايداً في الأشهر القادمة. أعلنت اللجان الكونغرسية بالفعل عن جلسات استماع حول أخلاقيات الذكاء الاصطناعي العسكرية. بالإضافة إلى ذلك، تقوم عدة مراكز بحثية ومؤسسات بحثية بتطوير أطر سياسية لنشر الذكاء الاصطناعي العسكري المسؤول.

الخلاصة

تمثل صفقة OpenAI مع البنتاغون مع الضمانات التقنية معلماً هاماً في دمج الذكاء الاصطناعي العسكري. يوضح الاتفاق أن النهج التفاوضية مع الحماية الأخلاقية المحددة يمكن أن تسهل الوصول الحكومي مع معالجة المخاوف المشروعة. ومع ذلك، تكشف التجربة المتناقضة مع Anthropic عن التوترات المستمرة بين أولويات الأمن القومي والمعايير الأخلاقية للشركات. مع استمرار تقدم تقنيات الذكاء الاصطناعي، ستتطلب هذه العلاقات المعقدة تنقلاً دقيقاً. قد تكون الضمانات التقنية المنشأة في اتفاق OpenAI نموذجاً للشراكات العسكرية والشركات المستقبلية. في نهاية المطاف، سيتطلب المشهد المتطور لتطبيقات الذكاء الاصطناعي العسكرية حواراً مستمراً بين الكيانات الحكومية وشركات التكنولوجيا والموظفين والمجتمع المدني لضمان الابتكار المسؤول الذي يحمي الأمن والقيم الديمقراطية.

الأسئلة الشائعة

س1: ما هي الضمانات المحددة التي تتضمنها صفقة OpenAI مع البنتاغون؟

يحظر الاتفاق تطبيقات المراقبة الجماعية المحلية ويحافظ على المسؤولية البشرية عن استخدام القوة، بما في ذلك أنظمة الأسلحة الذاتية. ستنفذ OpenAI ضمانات تقنية وتنشر مهندسين لضمان الامتثال.

س2: لماذا فشلت مفاوضات Anthropic مع البنتاغون؟

سعت Anthropic إلى قيود صريحة على المراقبة الجماعية المحلية والأسلحة الذاتية بالكامل، بينما دفع البنتاغون للوصول "لجميع الأغراض القانونية". منع هذا الخلاف الأساسي التوصل إلى اتفاق تفاوضي.

س3: ما هي العواقب التي واجهتها Anthropic لموقفها الأخلاقي؟

أمر الرئيس ترامب الوكالات الفيدرالية بالتخلص التدريجي من منتجات Anthropic، وصنف وزير الدفاع هيغسيث الشركة كخطر على سلسلة التوريد، مما يحظر على مقاولي الجيش التعامل معهم.

س4: كيف استجاب موظفو صناعة الذكاء الاصطناعي لهذه التطورات؟

وقع أكثر من 360 موظفاً من OpenAI وGoogle رسالة مفتوحة تدعم موقف Anthropic الأخلاقي، مما يعكس قلقاً داخلياً كبيراً بشأن تطبيقات الذكاء الاصطناعي العسكرية.

س5: ما هي الآثار الأوسع لهذا الوضع على حوكمة الذكاء الاصطناعي؟

تسلط النتائج المتناقضة الضوء على التوازن المعقد بين الأمن القومي وأخلاقيات الشركات والابتكار التكنولوجي، مما قد يؤثر على كيفية تعامل الدول والشركات الأخرى مع دمج الذكاء الاصطناعي العسكري.

ظهر هذا المنشور صفقة OpenAI مع البنتاغون: سام ألتمان يؤمن عقد وكيل الذكاء الاصطناعي حاسم مع ضمانات تقنية لأول مرة على BitcoinWorld.

قد يعجبك أيضاً

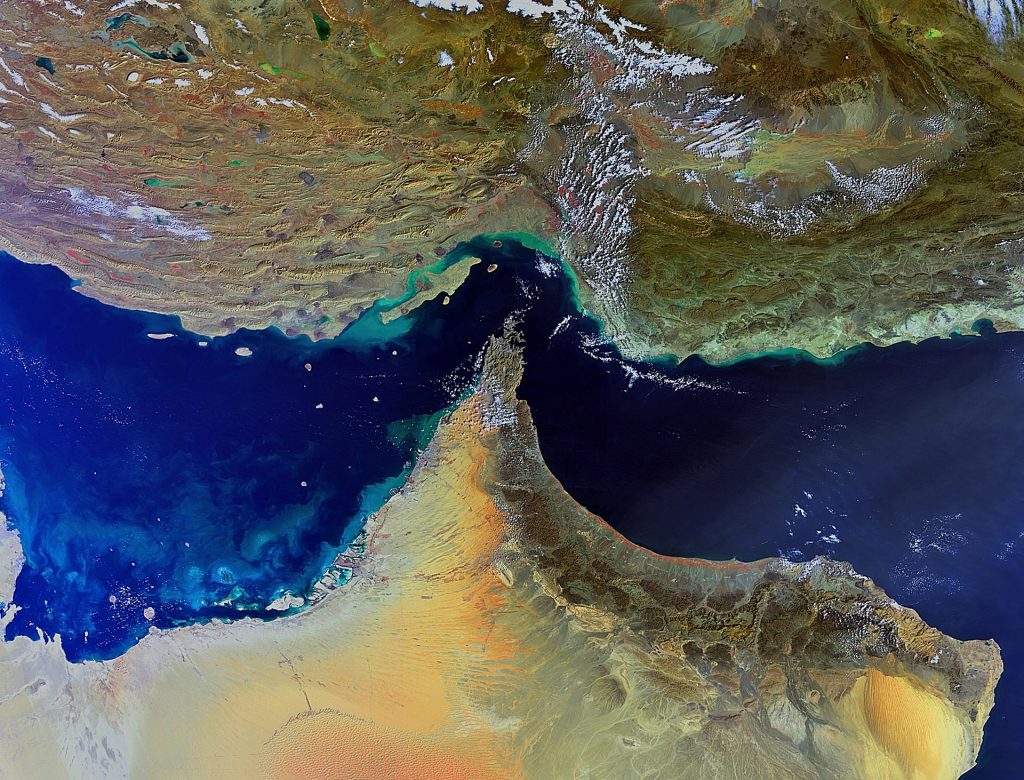

ماذا سيحدث إذا أغلقت إيران مضيق هرمز؟ البيانات تُظهر شيئًا واحدًا فقط

توقعات سعر اليورانيوم: يستقر بالقرب من 87$ مع انضغاط المؤشرات الفنية